深夜刷短视频时,你是否疑惑过“为何有些内容突然消失”?当直播画面被强制切断,平台究竟依据何种规则操作?这些看似寻常的现象背后,暗藏着覆盖60亿网民的系统性内容治理工程。将穿透表象,解析国内网络视听内容管理的核心机制与用户应对策略。

内容分级的本土化实践

我国并未采用国际通行的分级制度,而是构建了独有的“动态过滤体系”。以某头部短视频平台为例,其部署的AI系统每日扫描超8000万条内容,通过语义识别、图像分析和场景建模三重技术,实时标注风险标签。2023年数据显示,系统对暴力元素的识别准确率已达92.7%,但对某些文化隐喻类内容仍存在15%的误判率。

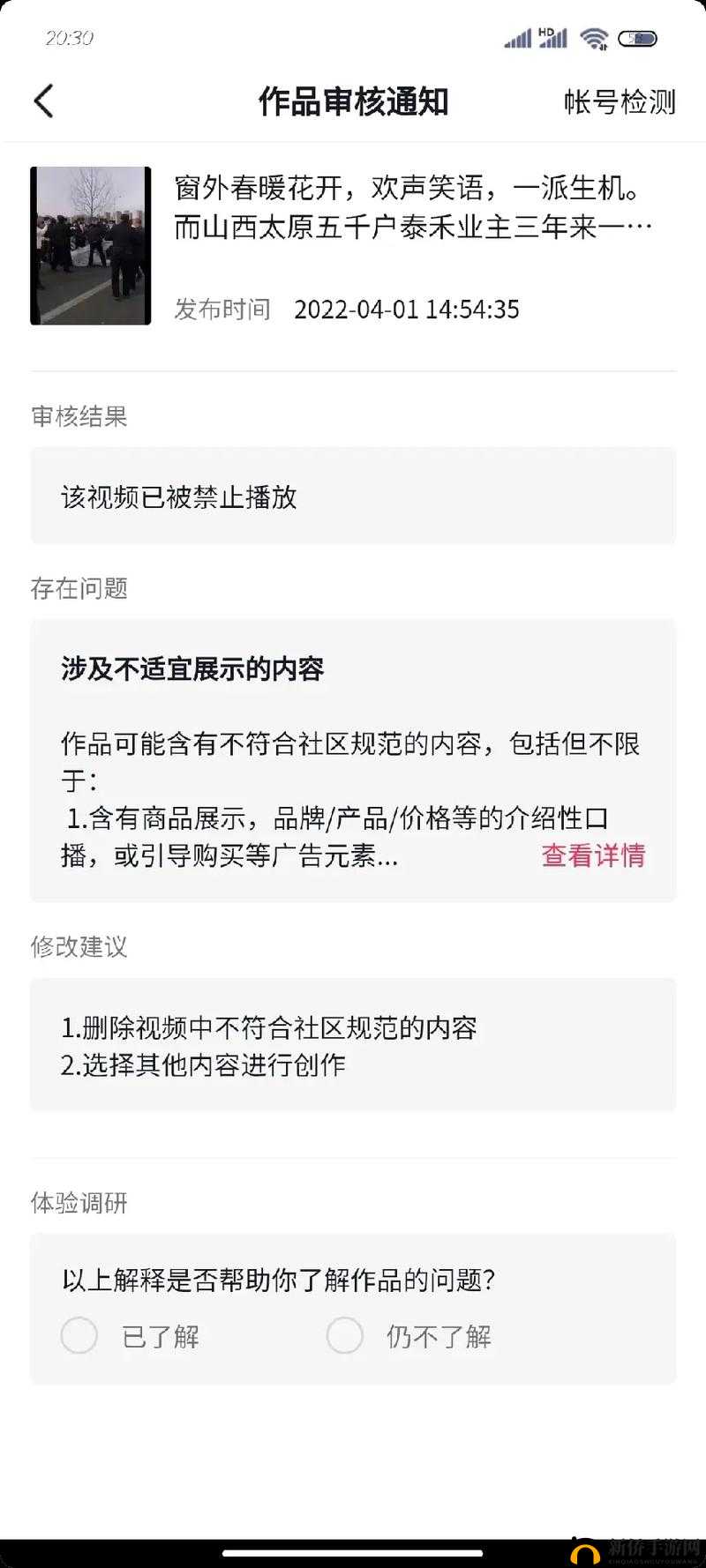

创作者常陷入的认知误区在于:认为只要规避明显违规元素即可。实际上,平台审核存在“关联触发机制”——当某类话题全网讨论量突破临界值时,相关关键词会自动进入临时敏感词库。曾有历史科普博主因解说古代冷兵器触发“潜在暴力”标签,导致视频限流。这要求创作者建立“风险关联思维”,预判内容可能引发的连锁反应。

审核技术的进化博弈

深度学习模型正引发审核方式的根本变革。某直播平台最新采用的“时空关联算法”,能识别主播连续3次擦边动作构成的暗示性行为。更值得关注的是情绪识别技术的应用:通过分析用户停留时长、互动频次和表情反馈,系统可逆向推导内容的情感诱导强度。2024年某音乐平台下架歌曲事件,正是算法捕捉到歌词引发的群体负面情绪波动所致。

用户端的应对智慧也在同步进化。教育类博主“知识捕手”的案例颇具启发性:其团队将敏感知识点拆解为隐喻动画+语音解说的组合形式,既保证内容完整度,又使审核系统将其归类为“教育科普”。这种“技术性表达”策略,使账号在半年内突破百万粉丝,内容通过率提升至87%。

规则透明化带来的新机遇

2023年网信办网络生态治理规定明确要求平台公示主要审核标准。研究头部平台的公开文档发现,违规判定已细化至217类场景,其中“不当类比”“情境误导”等新增条款,反映出审核维度向认知安全领域的延伸。某美食博主因展示“刀具特写超过8秒”触发审核,恰恰对应规则手册第143条“物品展示时长限制”。

这种透明化倒逼出新型创作方法论。纪录片团队“看见”在拍摄市井生活时,采用“去焦点化”拍摄手法:用广角镜头弱化个体特征,通过环境叙事传递信息。该系列作品不仅通过平台审核,更斩获行业纪录片奖项,证明合规与创作质量可兼得。

当数字世界的规则愈发清晰,内容创作正从“蒙眼狂奔”转向“戴着镣铐跳舞”。理解审核机制的深层逻辑,本质是掌握与数字文明对话的新语言。那些能在合规框架内找到创新表达的人,终将在内容生态的演进中赢得先机。